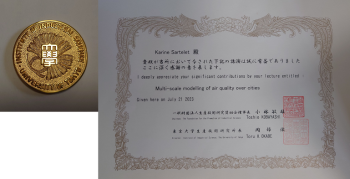

Modélisation de l’impact du trafic routier sur les concentrations de polluants en zone urbaine

La soutenance se tiendra le jeudi 8 juin 2023, de 14h à 17h, dans l’Amphithéâtre Cauchy, École des Ponts (6/8 Av. Blaise Pascal, 77420 Champs-sur-Marne).

Composition du jury

Pr Guy BRASSEUR, Max Planck Institute for Meteorology, Rapporteur

Dr Oriol JORBA, Barcelona Supercomputing Center, Rapporteur

Pr Isabelle COLL, Université Paris-Est Créteil, Examinatrice

Dr Yao LIU, Université Gustave Eiffel, Examinatrice

Pr Lionel SOULHAC, INSA Lyon, Examinateur

Dr Karine SARTELET, École nationale des ponts et chaussées, Directrice de thèse

Dr Yelva ROUSTAN, École nationale des ponts et chaussées, Co-encadrant de thèse

Dr Christophe CHAILLOU, Aramco, Invité

Résumé en français

En milieu urbain et en particulier dans les rues, les personnes sont exposées à de fortes concentrations de dioxyde d’azote (NO2), et de particules dont les aérosols organiques (OM) et le carbone suie (BC). Afin de mieux comprendre les sources et représenter l’évolution des concentrations dans les rues, une modélisation multi-échelle est utilisée, avec le modèle de réseaux de rues MUNICH couplé au modèle de chimie-transport régional Polair3D et au module chimique SSH-aerosol pour représenter la formation des composés secondaires aux différentes échelles.

L’influence des émissions des composés organiques volatils (COV) du trafic routier, des émissions hors dues à l’usure des hors échappements et des émissions d’asphalte est étudiée avec des scénarios de sensibilité. La simulation de référence utilise des facteurs d’émission standards obtenus de la méthodologie COPERT. L’utilisation de données récentes de mesure de spéciation permet de mieux caractériser les COV émis, en particulier les composés organiques intermédiaires, semi et faiblement volatils (COVI/S/F), engendrant une réduction des concentrations de OM allant jusqu’à 27 %. Une augmentation de 219 % des émissions de BC dues à l’usure des pneus, cohérente avec la littérature, double les concentrations de BC. Les émissions d’asphalte augmentent fortement les émissions de COVI/S/F. Les concentrations de particules simulées en prenant en compte ces émissions se comparent bien aux observations, soulignant l’importance de mieux caractériser cette source manquante dans les modèles.

Des simulations sont ensuite réalisées pour l’année 2030 afin d’évaluer les impacts futurs des émissions du trafic sur les concentrations. L’introduction de véhicules à très faibles émissions, conformes aux futures normes européennes d’émissions, induit une forte réduction des émissions par rapport à une flotte représentative de l’année 2014. Les émissions de NO2 et de BC sont réduites de 70 %, entrainant une diminution des concentrations de 52 % pour le NO2, 42 % pour le BC, et 20 % pour les particules. Les émissions d’une flotte composée uniquement de véhicules à très faibles émissions sont 99 % et 80 % plus faibles pour le NO2 et le BC respectivement, réduisant les concentrations de NO2 de 80 % et celles de BC de 45 %.

Pour représenter les gradients de concentrations dans les rues et mieux estimer l’exposition des personnes, une nouvelle version de MUNICH est développée. Plutôt que de considérer les concentrations homogènes dans chaque segment de rue, le volume des rues est discrétisé avec trois niveaux verticaux. Une discrétisation horizontale en deux zones est également introduite sous certaines conditions avec une paramétrisation tirée du modèle OSPM. Les concentrations simulées dans les rues de Copenhague et de l’est parisien avec cette version discrétisée de MUNICH se comparent mieux aux observations que celles simulées avec la version homogène, et les concentrations de NO2, BC et OM sont plus élevées en bas des rues.

Mots-clés : qualité de l’air, modélisation numérique, trafic routier, émissions, milieu urbain, polluants primaires et secondaires.

English abstract

In urban areas and in particular in the streets, populations are exposed to high concentrations of nitrogen dioxide (NO2), and particulate matter including organic aerosols (OM) and black carbon (BC). In order to better understand the sources and to represent the evolution of the concentrations in the streets, a multiscale modeling is used, with the street-network model MUNICH coupled to the regional chemistry-transport model Polair3D, and to the chemical module SSH-aerosol to represent the formation of the secondary compounds at the different scales.

The influence of volatile organic compound (VOC) emissions from road traffic, non-exhaust emissions due to tire wear and asphalt emissions are studied with sensitivity scenarios. The reference simulation uses standard emission factors obtained from the COPERT method- ology. The use of recent speciation measurement data allows for a better characterization of the emitted VOCs, in particular intermediate, semi and low volatile organic compounds (I/S/LVOC), resulting in a reduction of OM concentrations of up to 27 %. A 219 % increase in BC emissions from tire wear, consistent with the literature, doubles BC concentrations. Asphalt emissions strongly increase I/S/LVOC emissions. The simulated PM concentra- tions taking into account these emissions compare well with observations, highlighting the importance of better characterizing this missing source in the models.

Simulations are then performed for the year 2030 to assess the future impacts of traffic emissions on concentrations. The introduction of ultra-low emission vehicles, compliant with future European emission standards, results in a large reduction in emissions compared to a representative fleet of 2014. NO2 and BC emissions are reduced by 70 %, resulting in a decrease in concentrations of 52 % for NO2, 42 % for BC, and 20 % for PM. Emissions from a fleet of only ultra-low emission vehicles are 99 % and 80 % lower for NO2 and BC respectively, reducing NO2 concentrations by 80 % and BC concentrations by 45 %.

To represent the concentration gradients in the streets and to better estimate the popula- tion exposure, a new version of MUNICH is developed. Instead of considering homogeneous concentrations in each street segment, the street volume is discretized with three vertical levels. A horizontal discretization into two zones is also introduced under specific conditions with a parameterization from the OSPM model. The concentrations simulated in the streets of Copenhagen and eastern Paris with this discretized version of MUNICH compare better with observations than those simulated with the homogeneous version, and the concentrations of NO2, BC and OM are higher at the bottom of the streets.

Keywords: air quality, numerical modeling, road traffic, emissions, urban area, primary and secondary pollutants

FR

FR EN

EN